All you can AI in 15 minutes. Na úvod si řekneme, co je a není AI. Následně si ukážeme možnosti využití nástrojů s umělou inteligencí k usnadnění nejen každodenní práce na projektech. Nakonec zabrousíme do etiky umělé inteligence a posvítíme si na problémy, kterým při jejím použití můžeme čelit.

Úvod do AI

Na úvod trochu teorie. Obecně dělíme umělou inteligenci na Narrow (úzká) a General (obecná). Narrow AI dokáže perfektně vykonávat nějaký úzce definovaný úkol nebo sadu úkolů. Taková inteligence je v našich životech už roky, například jako FaceID, spam filtry a mnoho dalších.

Obecná AI naproti tomu vykazuje známky inteligentního chování napříč různými kognitivními úkoly. Takové umělé inteligence zatím neexistují a v následující dekádě pravděpodobně ani nebudou.

Proč se ale poslední dobou tolik bavíme o AI, když tady s námi už roky je? A nějaká pořádná tady ještě další dekádu nebude? Primárně proto, že nástroje jako Midjourney, Stability AI, ChatGPT nebo Github Compilot jsou generativní, tzn. že na základě dat vytváří nějaký nový obsah.

A proč nás to tolik zajímá a děsí zároveň? Primárně proto, že kreativitu považujeme za inherentně lidskou.

Chat GPT se nedá věřit

Pojďme začít u ChatGPT. V New York Times požádali ChatGPT (verze 3 ☝️), aby napsal essey o Antoine De Macheletovi, belgickém chemikovi. Ten okamžitě začal generovat esej, která ale byla celá fiktivní. To by asi nemělo nikoho překvapit – ChatGPT je jenom jazykový model, což vyplývá i z jeho názvu (GPT znamená Generative pre-trained transformer).

A podobně jsme si to vyzkoušeli i u nás, když jsme researchovali stakování na Solana blockchainu. A jak píše Dominik, “fakt mu nejde věřit”.

Hlavní problém je, že ChatGPT je Narrow AI zaměřená na sadu konkrétních úkolů – porozumění a generování textu. To neříká nic o pravdivosti generovaného textu.

AI != ChatGPT

AI nástrojů existuje opravdu hromada. Poslední dobou se před nimi na LinkedInu nedá schovat. A každý z nás jich určitě denně, ať už vědomě nebo nevědomky, používáme desítky. Já například každý den pracuji s Google Sheets. Ať už tam něco exportuji klientům nebo si potřebuji zpracovat data pro nějaké rozhodnutí.

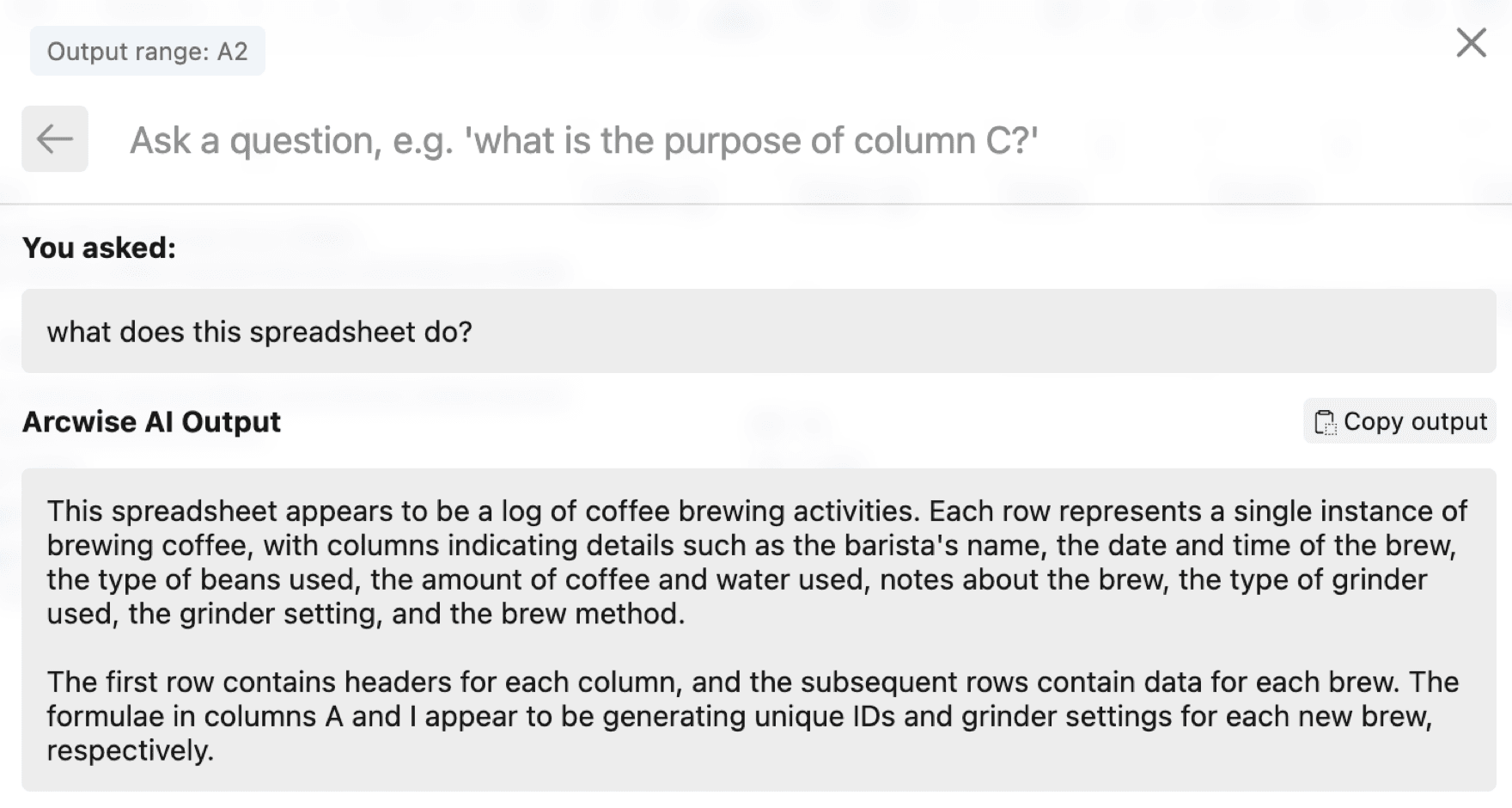

Arcwise je doplněk do Google Sheets, který umí například vysvětlit, k čemu sheet slouží, nebo třeba upravit, unifikovat či scrapovat data z otevřeného tabu.

Jednoduše se zeptám “what does this sheet do?” a dostanu jednoduchou odpověď vysvětlující hlavní funkce.

Každý den se také účastním několika meetingů. Obvykle je součástí mojí práce zapsat důležité body, rozdat další úkoly a udržovat kontext celého projektu.

Otter.ai (ale i další tooly jako MeetGeek nebo Firefly) se umí připojit do meetingu, automaticky ho nahrát, udělat transkript a poté sepsat meeting summary. Navíc v transkriptu všech schůzek následně můžete vyhledávat.

Jednou bude existovat kompletní AI archiv, který propojíte s transkripty schůzek, projektovými dokumenty nebo ticketingem a budeme v něm moct jednoduše vyhledávat.

Etika umělé inteligence

Umělá inteligence je v našich životech relativně nová a v zásadě neregulovaná. Je dobré znát i problémy, které AI přináší, a jak se k nim eticky postavit.

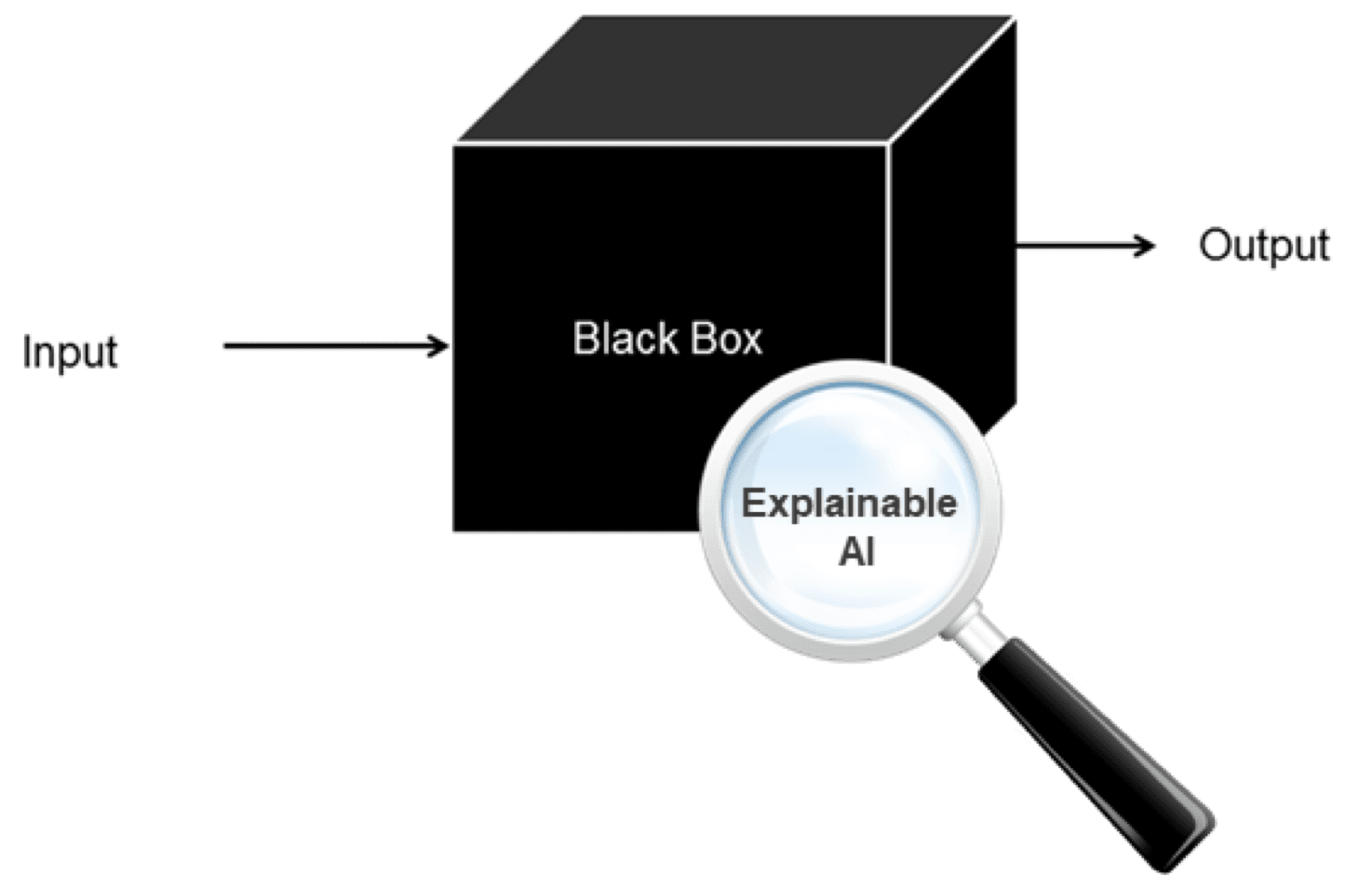

Když se vrátím k případu NYT s belgick�ým chemikem: Proč ChatGPT odpověděl, jak odpověděl? Proč si všechny údaje úplně vymyslel? A vadí nám to? Možná trochu. Ale je to spíš vtipný příběh. Ale co kdybychom chtěli vědět, proč nám Decision Support System doporučil dané rozhodnutí? Nebo proč náš Applicant Tracking System doporučil zamítnout daného uchazeče? HR specialisty bychom se také zeptali proč.

Tento problém je známý jako black box problem. Nikdo, často ani vývojáři, netuší, proč AI odpověděla jak odpověděla. Řešením black box problému je Explainable AI (XAI). Často nás totiž nezajímá jen odpověď, ale jak a proč k ní umělá inteligence došla.

Druhý problém, který představím, se nazývá garbage in, garbage out (smetí dovnitř, smetí ven). Jedná se o poměrně známý computer science princip. Nicméně garbage in neznamená zadání do ChatGPT a garbage out jeho odpověď.

Garbage in jsou tréninková data pro algoritmy strojového učení. Pokud vstupní data nejsou dostatečně kvalitní, ani výsledky nebudou dostatečně kvalitní. Špatná data mohou odrážet naše předchozí špatná rozhodnutí nebo naše vlastní předsudky. Mohou podreprezentovávat ženy nebo menšiny. Tyto problémy následně umělá inteligence pouze znásobí.

Jak to může dopadnout, když nevěnuji dostatečnou pozornost učícím datům? Třeba takto:

- iPhone X racism row: Apple's Face ID fails to distinguish between Chinese users

- Self-driving cars more likely to drive into black people, study claims

- Uber’s Self-Driving Car Didn’t Know Pedestrians Could Jaywalk

AI v projektovém řízení

Umělá inteligence nám může ušetřit spoustu práce. A může nám ušetřit práci, kterou často nechceme dělat. K výsledkům je však nutné přistupovat kriticky a uvědomovat si limity, které (minimálně zatím) umělá inteligence má. Sama je totiž hloupá způsobem, který neumíme pochopit. A já budu rád, když k ní tak budete přistupovat.